Deep supervision 是深度学习中的一种技术,通常用于改进模型训练的效果,尤其是在训练深度神经网络时。它通过在模型的多个中间层添加辅助监督信号(即额外的损失函数)来实现。这种方法有助于缓解梯度消失问题,加速收敛,并提高模型的泛化能力。以下是对deep supervision的详细解释:

基本概念

在传统的深度学习模型中,通常只有最后一层(输出层)直接受到监督信号的影响,即在这层计算损失并通过反向传播更新整个模型的参数。而在deep supervision中,除了最后一层,模型的某些中间层也会引入辅助的监督信号,计算辅助损失。这些辅助损失也会通过反向传播影响模型参数的更新。

实现方式

-

多层监督信号:在模型的多个中间层上添加额外的输出节点,每个节点对应一个损失函数。最终的总损失函数是这些中间层损失和最终层损失的加权和。

-

损失函数设计:这些中间层的损失函数可以与最终层的损失函数相同,也可以不同,具体设计取决于任务需求。常见的损失函数包括交叉熵损失、均方误差等。

-

权重平衡:总损失函数中的各个部分通常会有不同的权重系数,以平衡不同层的贡献。这些权重可以通过实验调整,或者使用动态调整策略。

优点

-

缓解梯度消失问题:通过在中间层提供直接的监督信号,deep supervision 可以有效地缓解深层网络中的梯度消失问题,使得梯度能够更有效地传播到模型的各个部分。

-

加速收敛:由于中间层也受到监督,模型在训练过程中可以更快地收敛,减少训练时间。

-

提高泛化能力:deep supervision 能够使模型在训练过程中学到更加鲁棒的特征,提高模型在测试数据上的表现。

应用实例

-

图像分割:在图像分割任务中,deep supervision 常用于 UNet 等网络结构,在不同分辨率的特征图上添加监督信号,以确保模型在不同尺度上都能学习到有用的特征。

-

分类任务:在分类任务中,如深层卷积神经网络(例如 ResNet),可以在某些中间层添加分类头,以辅助主任务,提高模型的分类性能。

示例代码

以下是一个使用 PyTorch 实现 deep supervision 的简化示例:

import torch

import torch.nn as nn

import torch.optim as optim

class DeepSupervisionNet(nn.Module):

def __init__(self):

super(DeepSupervisionNet, self).__init__()

self.layer1 = nn.Conv2d(1, 16, 3, padding=1)

self.layer2 = nn.Conv2d(16, 32, 3, padding=1)

self.layer3 = nn.Conv2d(32, 64, 3, padding=1)

self.fc = nn.Linear(64*8*8, 10) # Assume input image size is 32x32

self.aux_fc1 = nn.Linear(16*32*32, 10) # Auxiliary output 1

self.aux_fc2 = nn.Linear(32*16*16, 10) # Auxiliary output 2

def forward(self, x):

x1 = self.layer1(x)

aux_out1 = self.aux_fc1(x1.view(x1.size(0), -1))

x2 = self.layer2(x1)

aux_out2 = self.aux_fc2(x2.view(x2.size(0), -1))

x3 = self.layer3(x2)

out = self.fc(x3.view(x3.size(0), -1))

return out, aux_out1, aux_out2

model = DeepSupervisionNet()

criterion = nn.CrossEntropyLoss()

optimizer = optim.Adam(model.parameters(), lr=0.001)

# Example training loop

for data, target in train_loader:

optimizer.zero_grad()

output, aux_out1, aux_out2 = model(data)

loss_main = criterion(output, target)

loss_aux1 = criterion(aux_out1, target)

loss_aux2 = criterion(aux_out2, target)

total_loss = loss_main + 0.3 * loss_aux1 + 0.3 * loss_aux2 # Example weightings

total_loss.backward()

optimizer.step()

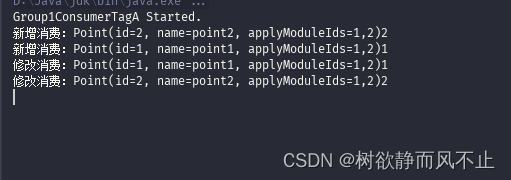

在这个示例中,网络包含了三个卷积层和一个全连接层,同时在前两个卷积层后添加了辅助输出,并计算其损失。这些损失与主损失一起反向传播,优化整个网络的参数。

总结

Deep supervision 是一种在训练深度神经网络时,通过在中间层添加辅助监督信号来改进训练效果的技术。它能够缓解梯度消失问题,加速收敛,并提高模型的泛化能力。